Zakaj moramo regulirati rabo umetne inteligence?

10. februar 2025

Montaža Danes je nov dan.

Optimizacija poti na Google Maps, filtriranje neželene elektronske pošte in priporočanje serij na Netflixu. Umetna inteligenca (UI) je že tako vpeta v naša življenja, da njene uporabe pogosto sploh ne opazimo. Vendar pa smo poleg relativno nevsiljivih primerov soočeni tudi s sistemi, ki imajo lahko velik vpliv na naše pravice. Sem spadajo tako rabe s strani držav, na primer profiliranje učencev, avtomatizirane odločitve o socialnih pravicah ali biometrično prepoznavanje, kot tudi zasebnih akterjev, na primer analize življenjepisov pri zaposlovanju, personalizacija spletnih oglasov ali predlaganje vsebin na družbenih omrežjih.

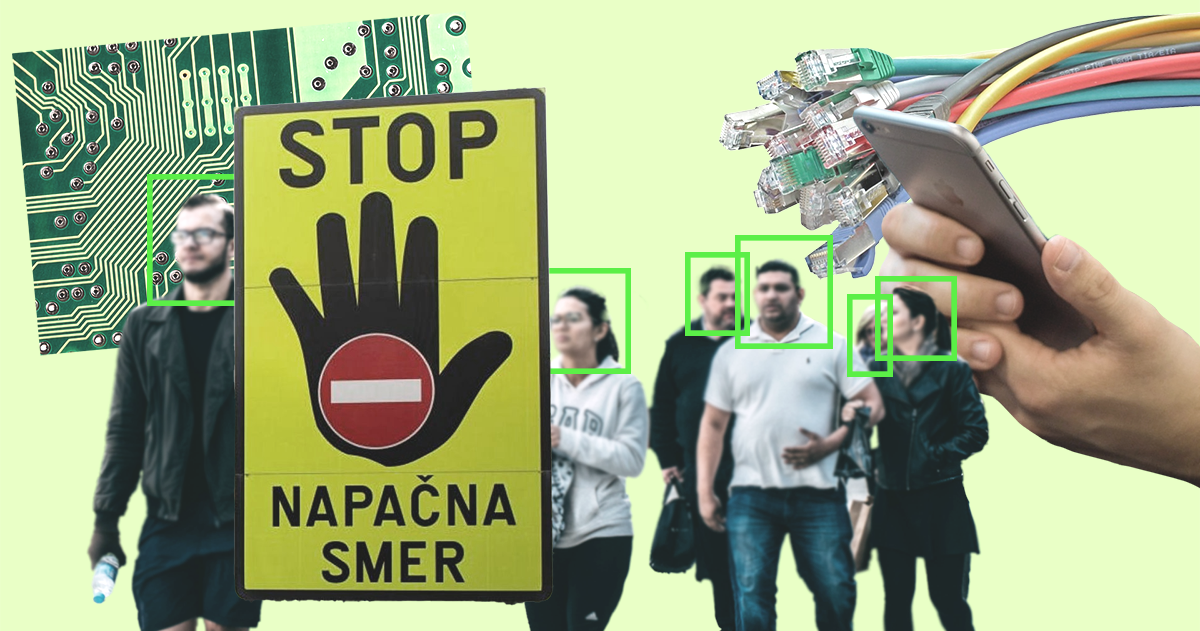

Tovrstne rabe prinašajo tudi nevarnosti. Tako lahko algoritmi sicer nadarjene otroke označijo kot problematične, ker ne sledijo tipičnim vzorcem učenja, posledice pa lahko segajo še dlje in vodijo do neupravičenega odvzema pravic ali množičnega nadzora. Prav zato moramo vedeti, kje vse se UI uporablja, razumeti, kakšna tveganja prinaša, in razmišljati o načinih, kako se pred njimi zaščitimo.

Zablode klepetalnih robotov in velikih jezikovnih modelov

Zakaj so klepetalni roboti in veliki jezikovni modeli, kot je ChatGPT, “pametni” zgolj na prvi pogled, že vemo. Tveganja, ki jih prinašajo, pa lahko segajo precej dlje od trivialnih napak, saj lahko prepričljivo zvečene, a povsem neresnične navedbe ogrozijo celo varnost in zdravje ljudi. To nam med drugim pokaže primer s pomočjo umetne inteligence napisanih vodičev za gobarjenje na Amazonu, ki so svetovali nabiranje in uživanje strupenih gob. Skrbi zbujajo tudi orodja, ki ponujajo pravno pomoč ali nasvete z drugih kompleksnih področij, saj ljudje rezultate pogosto jemljejo s preveliko mero zaupanja.

Črpanje virov in uničevanje okolja

UI ne more delovati brez čipov, baterij in drugih komponent, ki vsebujejo kovine, minerale in redke elemente, katerih rudarjenje povzroča ogromno škodo okolju. Gre tudi za izjemno energetsko potrošen sektor. Med drugim velik problem predstavljajo podatkovni centri, katerih globalna poraba energije že zdaj dosega raven celotnih držav – po ocenah IEA je namreč primerljiva s porabo električne energije Japonske. Prav zato je ključno, da zahtevamo takojšen prehod na obnovljive vire in izvedbo transparentnih okoljskih študij, predvsem pa kolikor se da omejimo rabo UI tehnologij.

Clarote & AI4Media / Better Images of AI / Labour/Resources / CC-BY 4.0

Kdaj se lahko obrnemo na zakonodajo?

Čeprav je na področju regulacije največ pozornosti namenjene aktu o umetni inteligenci, ki ga je sprejela EU, v veljavo pa je stopil 1. avgusta 2024, UI že urejajo nekateri obstoječi zakoni. Akt o digitalnih storitvah (DSA) ščiti uporabnike spletnih platform in družbenih omrežij tako, da od slednjih zahteva večjo transparentnost algoritmov, možnost izklopa algoritmičnega priporočanja vsebin in vpogled v ciljano oglaševanje. Splošna uredba o varstvu podatkov (GDPR) vpeljuje varovalke, kot so pravica do pozabe (izbris osebnih podatkov iz UI sistemov), večjo transparentnost glede obdelave podatkov in zaščito pred odločitvami, ki temeljijo na avtomatizirani obdelavi podatkov oz. profiliranju. Avtorsko pravo pa ščiti ustvarjalce pred zlorabami generativne UI, ki njihova dela pogosto uporablja brez dovoljenja oz. finančnega nadomestila.

Akt o umetni inteligenci je prvi globalni poskus celovite regulacije UI, namenjene zaščiti temeljnih pravic in zmanjševanju nevarnosti. Sisteme deli glede na tveganje, pri čemer so visokotveganim, kot so tisti na področjih šolstva, zaposlovanja ali nadzora meja, naložene strožje zahteve glede transparentnosti in uporabe podatkov. Žal pa ima številne pomanjkljivosti, kot so izjeme na področjih kazenskega pregona in nacionalne varnosti, kjer so dovoljena celo orodja za biometrično prepoznavanje, ter manko regulacije generativne UI in zasebnega sektorja. V prihodnje bo zato treba zahtevati strožjo regulacijo, še posebej pri prenosu ukrepov v nacionalno zakonodajo.

Kako do odgovorne rabe UI?

Ker vsaj za zdaj kaže, da zakonodaja ne stori dovolj za zaščito naših pravic, lahko za odgovorno rabo UI poskrbi tudi kombinacija notranjih pravil organizacij in aktivnega delovanja civilne družbe. Pri tem so ključna orodja, kot so ocena vpliva na temeljne pravice (FRIA) in interni kodeksi organizacij, ki lahko dvignejo raven transparentnosti, nadzora in etične rabe UI sistemov, dodaten korak pa lahko prispevajo še projekti, kot je Register rabe UI. Predvsem pa je ključno, da se vedno znova vprašamo, ali je umetna inteligenca res potrebna in smiselna na vsakem koraku naših življenj – ali pa utegne morda prinesti več težav kot koristi.

Prispevek je povzetek četrtega predavanja iz serije Mini tečAI: Umetna inteligenca od A do NVO. Dogodki so bili zasnovani posebej za nevladne in civilnodružbene organizacije ter vse, ki morda nimajo poglobljenega znanja o tehnoloških vidikih umetne inteligence, a želijo bolje razumeti, kako umetna inteligenca vpliva na njihovo delo in kako se z njo učinkovito spoprijeti.

Posnetek četrtega predavanja: O rabi in nadzoru

Na četrtem predavanju se nam je kot gostujoči govorec pridružil Domen Savič iz zavoda Državljan D, ki je predstavil primer nadzora civilne družbe na tem področju.

Povezani zapisi

Priporočamo, svetujemo, vabimo, opozarjamo in še kaj drugega

25. november 2024

5. december 2024

23. januar 2025